Amazon Web Services (AWS) telah mengumumkan pembaruan baru untuk Guardrails for Amazon Bedrock, yang dirancang untuk meningkatkan keamanan dan kepercayaan aplikasi AI generatif. Pembaruan ini mencakup deteksi halusinasi dan API independen untuk memperkuat aplikasi dengan pagar pembatas yang disesuaikan di semua model, memastikan hasil yang bertanggung jawab dan tepercaya.

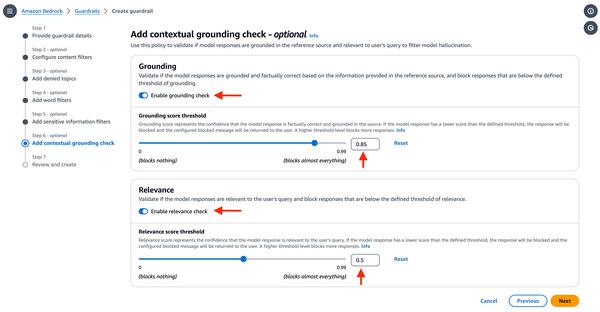

Fitur deteksi halusinasi adalah tambahan yang berharga, memungkinkan pelanggan untuk memverifikasi keakuratan respons model berdasarkan sumber referensi dan kueri pengguna. Ini membantu memastikan bahwa model tidak menghasilkan informasi yang salah atau baru yang tidak didasarkan pada data faktual.

ApplyGuardrail API memungkinkan pelanggan untuk mengevaluasi masukan pengguna dan respons model terhadap pengamanan yang dikonfigurasi. Fitur ini sangat berguna untuk organisasi yang menggunakan LLM yang dikelola sendiri atau pihak ketiga, karena memungkinkan mereka untuk menerapkan langkah-langkah keamanan standar di semua aplikasi mereka.

Dengan pembaruan ini, AWS menegaskan kembali komitmennya untuk menyediakan alat dan solusi yang memberdayakan pelanggan untuk membangun aplikasi AI generatif yang aman dan andal. Guardrails for Amazon Bedrock adalah langkah penting ke arah ini, yang menawarkan kontrol lebih besar kepada pelanggan atas perilaku LLM yang mereka gunakan.

Pelanggan yang tertarik untuk mempelajari lebih lanjut tentang fitur-fitur baru ini dapat mengunjungi halaman produk Guardrails for Amazon Bedrock di situs web AWS.